最小二乘法

數學優化技術

最小二乘法(又稱最小平方法)是一種數學優化技術。它通過最小化誤差的平方和尋找數據的最佳函數匹配。利用最小二乘法可以簡便地求得未知的數據,並使得這些求得的數據與實際數據之間誤差的平方和為最小。最小二乘法還可用於曲線擬合。其他一些優化問題也可通過最小化能量或最大化熵用最小二乘法來表達。

根據樣本數據,採用最小二乘估計式可以得到簡單線性回歸模型參數的估計量。但是估計量參數與總體真實參數的接近程度如何,是否存在更好的其它估計式,這就涉及到最小二乘估計式或估計量的最小方差(或最佳)(Best)性、線性(Linear)及無偏(Unbiased)性,簡稱為BLU特性。這就是廣泛應用普通最小二乘法估計經濟計量模型的主要原因。下面證明普通最小二乘估計量具有上述三特性 。

1、線性特性

所謂線性特性,是指估計量分別是樣本觀測值的線性函數,亦即估計量和觀測值的線性組合 。

2、無偏性

無偏性,是指參數估計量的期望值分別等於總體真實參數 。

3、最小方差性

所謂最小方差性,是指估計量與用其它方法求得的估計量比較,其方差最小,即最佳。最小方差性又稱有效性。這一性質就是著名的高斯一馬爾可夫(Gauss-Markov)定理。這個定理闡明了普通最小二乘估計量與用其它方法求得的任何線性無偏估計量相比,它是最佳的 。

在無約束最優化問題中,有些重要的特殊情形,比如目標函數由若干個函數的平方和構成,這類函數一般可以寫成 :

其中 ,通常要求m≥n,我們把極小化這類函數的問題 :

稱為最小二乘優化問題。最小二乘優化是一類比較特殊的優化問題 。

最小二乘法是解決曲線擬合問題最常用的方法。其基本思路是:令

其中, 是事先選定的一組與線性關係無關的函數, 是待定係數 ,擬合準則是使 與 的距離 的平方和最小,稱為最小二乘準則 。

考慮超定方程組(超定指未知數小於方程個數):

其中m代表有m個等式,n代表有n個未知數,m>n;將其進行向量化後為:

顯然該方程組一般而言沒有解,所以為了選取最合適的讓該等式"盡量成立",引入殘差平方和函數S

(在統計學中,殘差平方和函數可以看成n倍的均方誤差MSE)

當時,取最小值,記作:

通過對進行微分求最值,可以得到:

如果矩陣非奇異則有唯一解:

在我們研究兩個變數(x,y)之間的相互關係時,通常可以得到一系列成對的數據(x1,y1.x2,y2...xm,ym);將這些數據描繪在x-y直角坐標系中,若發現這些點在一條直線附近,可以令這條直線方程如(式1-1)。(式1-1)

其中:a0、a1是任意實數

為建立這直線方程就要確定a0和a1,應用《最小二乘法原理》,將實測值Yi與利用計算值Yj(Yj=a0+a1Xi)(式1-1)的離差(Yi-Yj)的平方和最小為“優化判據”。

令:φ=(式1-2)

把(式1-1)代入(式1-2)中得:

φ=(式1-3)

當最小時,可用函數φ對a0、a1求偏導數,令這兩個偏導數等於零。

∑2(a0+a1*Xi-Yi)=0(式1-4)

∑2Xi(a0+a1*Xi-Yi)=0(式1-5)

亦即:

na0+(∑Xi)a1=∑Yi(式1-6)

(∑Xi)a0+(∑Xi^2)a1=∑(Xi*Yi)(式1-7)

得到的兩個關於a0、a1為未知數的兩個方程組,解這兩個方程組得出:

a0=(∑Yi)/n-a1(∑Xi)/n(式1-8)

a1=[n∑(XiYi)-(∑Xi∑Yi)]/(n∑Xi^2-∑Xi∑Xi)(式1-9)

這時把a0、a1代入(式1-1)中,此時的(式1-1)就是我們回歸的一元線性方程即:數學模型。

在回歸過程中,回歸的關聯式不可能全部通過每個回歸數據點(x1,y1.x2,y2...xm,ym),為了判斷關聯式的好壞,可藉助相關係數“R”,統計量“F”,剩餘標準偏差“S”進行判斷;“R”越趨近於1越好;“F”的絕對值越大越好;“S”越趨近於0越好。

R=[∑XiYi-m(∑Xi/m)(∑Yi/m)]/SQR{[∑Xi2-m(∑Xi/m)2][∑Yi2-m(∑Yi/m)2]}(式1-10)*

在(式1-10)中,m為樣本容量,即實驗次數;Xi、Yi分別為任意一組實驗數據X、Y的數值。

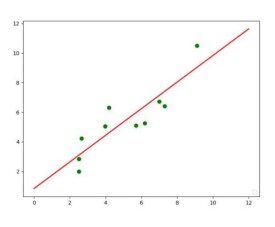

以最簡單的一元線性模型來解釋最小二乘法。什麼是一元線性模型呢?監督學習中,如果預測的變數是離散的,我們稱其為分類(如決策樹,支持向量機等),如果預測的變數是連續的,我們稱其為回歸。回歸分析中,如果只包括一個自變數和一個因變數,且二者的關係可用一條直線近似表示,這種回歸分析稱為一元線性回歸分析。如果回歸分析中包括兩個或兩個以上的自變數,且因變數和自變數之間是線性關係,則稱為多元線性回歸分析。對於二維空間線性是一條直線;對於三維空間線性是一個平面,對於多維空間線性是一個超平面。

對於一元線性回歸模型,假設從總體中獲取了n組觀察值(X1,Y1),(X2,Y2),…,(Xn,Yn)。對於平面中的這n個點,可以使用無數條曲線來擬合。要求樣本回歸函數儘可能好地擬合這組值。綜合起來看,這條直線處於樣本數據的中心位置最合理。選擇最佳擬合曲線的標準可以確定為:使總的擬合誤差(即總殘差)達到最小。有以下三個標準可以選擇:

(1)用“殘差和最小”確定直線位置是一個途徑。但很快發現計算“殘差和”存在相互抵消的問題。

(2)用“殘差絕對值和最小”確定直線位置也是一個途徑。但絕對值的計算比較麻煩。

(3)最小二乘法的原則是以“殘差平方和最小”確定直線位置。用最小二乘法除了計算比較方便外,得到的估計量還具有優良特性。這種方法對異常值非常敏感。

最常用的是普通最小二乘法(OrdinaryLeastSquare,OLS):所選擇的回歸模型應該使所有觀察值的殘差平方和達到最小。(Q為殘差平方和)-即採用平方損失函數。

樣本回歸模型:

平方損失函數:

解得:

對給定數據點集合,在取定的函數類中,求,使誤差的平方和最小,。從幾何意義上講,就是尋求與給定點集的距離平方和為最小的曲線y=p(x)。函數p(x)稱為擬合函數或最小二乘解,求擬合函數p(x)的方法稱為曲線擬合的最小二乘法。

最小二乘法的矩陣形式

最小二乘法的矩陣形式為:

其中為的矩陣,為的列向量,為的列向量。如果(方程的個數大於未知量的個數),這個方程系統稱為矛盾方程組(OverDeterminedSystem),如果(方程的個數小於未知量的個數),這個系統就是UnderDeterminedSystem。

正常來看,這個方程是沒有解的,但在數值計算領域,我們通常是計算,解出其中的。比較直觀的做法是求解,但通常比較低效。其中一種常見的解法是對進行QR分解(),其中是正交矩陣(OrthonormalMatrix),是上三角矩陣(UpperTriangularMatrix),則有

用MATLAB命令

x=R\(Q\b)

可解得。

最小二乘法的Matlab實現

②多項式函數線性擬合使用polyfit(x,y,n),n為次數

擬合曲線

x=[0.5,1.0,1.5,2.0,2.5,3.0],

y=[1.75,2.45,3.81,4.80,7.00,8.60]。

解:MATLAB程序如下:

x=[0.5,1.0,1.5,2.0,2.5,3.0];y=[1.75,2.45,3.81,4.80,7.00,8.60];p=polyfit(x,y,2)x1=0.5:0.5:3.0;y1=polyval(p,x1);plot(x,y,'*r',x1,y1,'-b')

計算結果為:

p =0.5614 0.8287 1.1560

即所得多項式為y=0.5614x^2+0.8287x+1.15560

③非線性函數使用

lsqcurvefit(fun,x0,x,y)a=nlinfit(x,y,fun,b0)

最小二乘法在交通運輸學中的運用

交通發生預測的目的是建立分區產生的交通量與分區土地利用、社會經濟特徵等變數之間的定量關係,推算規劃年各分區所產生的交通量。因為一次出行有兩個端點,所以我們要分別分析一個區生成的交通和吸引的交通。交通發生預測通常有兩種方法:回歸分析法和聚類分析法。

回歸分析法是根據對因變數與一個或多個自變數的統計分析,建立因變數和自變數的關係,最簡單的情況就是一元回歸分析,一般式為:Y=α+βX式中Y是因變數,X是自變數,α和β是回歸係數。若用上述公式預測小區的交通生成,則以下標i標記所有變數;如果用它研究分區交通吸引,則以下標j標記所有變數。而運用公式的過程中需要利用最小二乘法來求解,上述公式中的回歸係數根據最小二乘法可得:

其中,式中的X拔是規劃年的自變數值,Y拔是規劃年分區交通生成(或吸引)預測值。