Infiniband

用於高性能計算的通信標準

InfiniBand(直譯為“無限帶寬”技術,縮寫為IB)是一個用於高性能計算的計算機網路通信標準,它具有極高的吞吐量和極低的延遲,用於計算機與計算機之間的數據互連。InfiniBand也用作伺服器與存儲系統之間的直接或交換互連,以及存儲系統之間的互連。

InfiniBand

與目前計算機的I/O子系統不同,InfiniBand是一個功能完善的網路通信系統。InfiniBand貿易組織把這種新的匯流排結構稱為I/O網路,並把它比作開關,因為所給信息尋求其目的地址的路徑是由控制校正信息決定的。InfiniBand使用的是網際協議版本6的128位地址空間,因此它能提供近乎無限量的設備擴展性。

通過InfiniBand傳送數據時,數據是以數據包方式傳輸,這些數據包會組合成一條條信息。這些信息的操作方式可能是遠程直接內存存取的讀寫程序,或者是通過通道接受發送的信息,或者是多點傳送傳輸。就像大型機用戶所熟悉的通道傳輸模式,所有的數據傳輸都是通過通道適配器來開始和結束的。每個處理器(例如個人電腦或數據中心伺服器)都有一個主機通道適配器,而每個周邊設備都有一個目標通道適配器。通過這些適配器交流信息可以確保在一定服務品質等級下信息能夠得到有效可靠的傳送。

我們為什麼需要InfiniBand?

採用Intel架構的處理器的輸入/輸出性能會受到PCI或者PCI-X匯流排的限制。匯流排的吞吐能力是由匯流排時鐘決定的(比如33.3MHz,66.6MHz以及133.3MHz)和匯流排的寬度(比如32位或者64位)。在最通常的配置中,PCI匯流排速度被限制在500MB/秒,而PCI-X匯流排速度被限制在1GB/秒。這種速度上的限制制約了伺服器和存儲設備、網路節點以及其他伺服器通訊的能力。在InfiniBand的技術構想中,InfiniBand直接集成到系統板內,並且直接和CPU以及內存子系統互動。但是,在短期內,InfiniBand支持將由PCI和PCI-X適配器完成;這樣,InfiniBand在最初將會受到匯流排的制約。在2002年年底,InfiniBand技術將會完全被整合在Intel伺服器供應商以及Sun生產的伺服器中(80%的可能性)

誰在倡導InfiniBand?

InfiniBand是由InfiniBand行業協會所倡導的。協會的主要成員是:康柏,戴爾,惠普,IBM,Intel,微軟和Sun。從歷史的角度看,InfiniBand代表了兩種計算潮流的融合:下一代I/O(NGIO)和未來的I-O(FIO)。大部分NGIO和FIO潮流的成員都加入了InfiniBand陣營。

InfiniBand是純硬體的嗎?

不。InfiniBand的成功還需要軟體--包括很多不同的層。這種技術架構和架構上的代理(伺服器,存儲設備,通訊設備,switch以及其他的一些設備)都需要軟體管理。應用軟體也必須適應這種架構。操作系統也必須進行調整以和晶元組進行最優化的通信。我們認為InfiniBand的相關軟體的發展將會成為InfiniBand產品應用的一個瓶頸。但是,到2005年,80%大、中型企業都會有在數據中心環境下的正式的InfiniBand產品。

Windows 2000支持InfiniBand嗎?

既支持也不支持。在InfiniBand的試製,測試階段,對InfiniBand的支持是由設備供應商的驅動來提供的,而不是直接由操作系統來支持。而且,微軟沒有時間把對InfiniBand的支持加入到它的Windows 2000中。不過微軟有可能在2002年第二季度把這種支持添加進來。(60%的可能性)

InfiniBand會取代線纜通道嗎?

還沒有計劃。就象InfiniBand技術完全被整合到伺服器的軟體和硬體中需要時間一樣,它被完全整合到存儲設備和SAN中也需要時間。2003年,90%的InfiniBand伺服器會採用InfiniBand-線纜通道、InfiniBand-千兆乙太網或者InfiniBand-SCSI橋的方式連接網路上的外接存儲。(90%的可能性)。

InfiniBand會取代千兆(或者更快的)乙太網嗎?

對這個問題的回答是:不會。乙太網是應用於高層網路通信(比如TCP/IP)的技術,而InfiniBand是用於低層輸入/輸出通信的技術。即使乙太網達到甚至超過了InfiniBand的速度,高層網路通信的特點使得它也不能夠成為適合伺服器端輸入/輸出的解決方案。總結:InfiniBand架構肩負著改善伺服器端輸入/輸出性能的使命。但是,InfiniBand不僅僅是晶元和硬體。為了發揮應有的作用,硬體和軟體必須充分在操作系統,管理層以及應用層整合起來。按照技術激進程度劃分,“A類型”的企業將會在2002年第二季度考慮小批量生產InfiniBand產品,而沒有那麼激進的企業可能會等到2003年第一季度或者更遲。

如果你還沒有關注InfiniBand,那要準備好應付鋪天蓋地的相關信息,甚至是產品。經過多年的醞釀,和使其成為規範的努力,以及實驗室的開發。InfiniBand即將橫空出世。不管你最終採用InfiniBand,或是放棄,亦或是等等看看,你都要了解這種用於數據中心的新型互聯技術。

InfiniBand產品正逐步進入市場,預計在2003年將有大批產品上市。由康柏、戴爾、惠普、IBM、英特爾、微軟和SUN公司於1999年創建的InfiniBand行業協會(IBTA),有180多家公司參加。這些業界巨人也組成了籌劃指導委員會。自從2000年1月以來,共吸收了3億美元的風險資金,很明顯,InfiniBand是業界推出的重大項目。

存儲網路界的許多大公司認為,InfiniBand將會作為PCI匯流排的替代品,首先出現在伺服器內部。這樣就很容易解釋為什麼他們對InfiniBand互聯不熱心。但是,沒有什麼事情是必然的。隨著啟動的一系列工作,InfiniBand將會很容易地進入存儲網路。如果InfiniBand確實作為PCI的替代品用於數據中心,則會出現這樣的情況,或者InfiniBand證明自己同樣適用網路傳輸,或者需要進一步的開發。

這就是要關注該技術的原因。或許需要投入時間、資金,並重新規劃,但是,這會潛在地改進公司的互聯體系結構。

InfiniBand如何工作

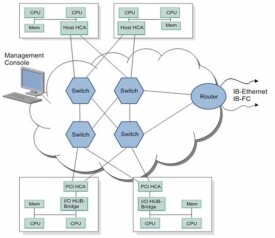

InfiniBand是一個統一的互聯結構,既可以處理存儲I/O、網路I/O,也能夠處理進程間通信(IPC)。它可以將磁碟陣列、SANs、LANs、伺服器和集群伺服器進行互聯,也可以連接外部網路(比如WAN、VPN、網際網路)。設計InfiniBand的目的主要是用於企業數據中心,大型的或小型的。目標主要是實現高的可靠性、可用性、可擴展性和高的性能。InfiniBand可以在相對短的距離內提供高帶寬、低延遲的傳輸,而且在單個或多個網際網路路中支持冗餘的I/O通道,因此能保持數據中心在局部故障時仍能運轉。

如果深入理解,你會發現InfiniBand與現存的I/O技術在許多重要的方面都不相同。不像PCI、PCI-X、IDE/ATA和SCSI那樣共享匯流排,因此沒有相關的電子限制、仲裁衝突和內存一致性問題。相反,InfiniBand在交換式網際網路路上,採用點到點的、基於通道的消息轉發模型,同時,網路能夠為兩個不同的節點提供多種可能的通道。

這些方面,InfiniBand更像乙太網,而乙太網構成LANs、WANs和網際網路的基礎。InfiniBand和以太網都是拓撲獨立──其拓撲結構依賴於交換機和路由器在源和目的之間轉發數據分組,而不是靠具體的匯流排和環結構。像乙太網一樣,InfiniBand能夠在網路部件故障時重新路由分組,分組大小也類似。InfiniBand的分組大小從256b到4KB,單個消息(攜帶I/O處理的一系列數據分組)可以達到2GB。

乙太網跨越全球,InfiniBand則不同,其主要用於只有幾間機房的數據中心,分佈於校園內或者位於城市局部。最大距離很大程度上取決於纜線類型(銅線或光纖)、連接的質量、數據速率和收發器。如果是光纖、單模的收發器和基本數據速率的情況下,InfiniBand的最大距離大約是10公里。

如同乙太網一樣使用交換機和路由器,InfiniBand在理論上能夠跨越更遠的距離,儘管如此,在實際應用中距離要受到更多的限制。為了確保數據分組的可靠傳輸,InfiniBand具備諸如反應超時、流控等特點,以防止阻塞造成的分組丟失。延長InfiniBand的距離將降低這些特徵的有效性,因為延遲超過了合理的範圍。

為了超越數據中心的範圍,其它I/O技術必須解決長距離的問題。InfiniBand廠商通過能夠連接到乙太網和光纖通道網路的設備來解決這個問題(光纖通道的最大距離大約為10公里,因此橋接設備使得InfiniBand能夠與現存的用光纖通道連接的校園網路和城域網路的分散式數據中心相兼容)。

更高的速度

InfiniBand的基本帶寬是2.5Gb/s,這是InfiniBand1.x。InfiniBand是全雙工的,因此在兩個方向上的理論最大帶寬都是2.5Gb/s,總計5Gb/s。與此相反,PCI是半雙工,因此32位、33MHz的PCI匯流排單個方向上能達到的理論最大帶寬是1Gb/s,64位、133MHz的PCI-X匯流排能達到8.5Gb/s,仍然是半雙工。當然,任何一種匯流排的實際吞吐量從來沒有達到理論最大值。

如果要獲取比InfiniBand1.x更多的帶寬,只要增加更多纜線就行。InfiniBand1.0規範於2000年10月完成,支持一個通道內多個連接的網路,數據速率可提高4倍(10Gb/s)和12倍(30Gb/s),也是雙向的。

InfiniBand是在串列鏈路上實現超高速率的,因此電纜和連接器相對并行I/O介面PCI、IDE/ATA、SCSI和IEEE-1284來說,介面小也便宜。并行鏈路有一個固有的優勢,因為它的多個纜線相當於高速公路上的多個車道,但現代的I/O收發器晶元使串列鏈路達到更高的數據速率,並且價格便宜。這就是為什麼最新的技術──InfiniBand、IEEE-1394、串列ATA、串列連接SCSI、USB採用串列I/O而不是并行I/O。

InfiniBand的擴展性非常高,在一個子網內可支持上萬個節點,而每個網路中可有幾千個子網,每個安裝的系統中可以有多個網路結構。InfiniBand交換機通過子網路由分組,InfiniBand路由器將多個子網連接在一起。相對乙太網,InfiniBand可以更加分散地進行管理,每個子網內有一個管理器,其在路由分組、映射網路拓撲、在網路內提供多個鏈路、監視性能方面起決定性的作用。子網管理器也能保證在特別通道內的帶寬,並為不同優先權的數據流提供不同級別的服務。子網並不一定是一個單獨的設備,它可以是內置於交換機的智能部件。

虛擬高速公路

為了保證帶寬和不同級別的服務,子網管理器使用虛擬通道,其類似於高速公路的多個車道。通道是虛擬的,而不是實際存在的,因為它不是由實際的纜線組成的。通過使用位元組位元組,並根據不同的優先權,同一對纜線可攜帶不同分組的片斷。

開發中的標準:

產品物理I/O主要應用最大帶寬最大距離

InfiniBand1x串列存儲

IPC網路2.5Gb/s10公里

InfiniBand4x串列-多鏈路存儲、IPC、網路10Gb/s10公里

InfiniBand12x串列-多鏈路存儲、IPC、網路30Gb/s10公里

光纖通道串列存儲

IPC網路2Gb/s10公里

Ultra2SCSI16位并行存儲0.6Gb/s12米

Ultra3SCSI16位并行存儲1.2Gb/s12米

IDE/UltraATA10032位并行存儲0.8Gb/s1米

IEEE-1394a(FireWire)串列存儲0.4Gb/s4.5米

串列ATA1.0串列存儲1.5Gb/s1米

串列連接SCSI串列存儲未定義未定義

PCI2.2(33/66MHz)32/64位并行底板1/2Gb/s主板

PCI-X1.0(133MHz)64位并行底板8.5Gb/s主板

PCI-X2.0(DDR-QDR)64位并行底板34Gb/s主板

InfiniBand 1.0定義了16個虛擬通道,0到15通道。通道15預留給管理使用,其它通道用於數據傳輸。一個通道專用於管理可以防止流量擁塞時妨礙網路的正常管理。比如,網路隨時準備改變其拓撲結構。InfiniBand設備是熱插拔的,從網路中拔出設備時要求網路迅速重新配置拓撲映射。子網管理器使用通道15來查詢交換機、路由器和終端節點其有關配置的改變。

除了數據虛擬通道外預留虛擬管理通道,這就是帶內管理。InfiniBand也提供帶外管理的選項。在InfiniBand的底板配置中,管理信號使用獨立於數據通道的特殊通道。底板配置更多用於伺服器內和存儲子系統,同樣地,PCI和PCI-X的底板也位於此。

除了虛擬通道上直接傳輸,子網管理器也可以對兩個節點之間的點對點的通道調整並匹配數據速率。比如,如果一個伺服器有一個到網路的4倍的介面,而發送數據的目標存儲子系統只有1倍的介面,交換機能夠自動建立兼容的1倍通道,而不丟失分組和阻止更高速率的數據傳輸。

實現InfiniBand

InfiniBand不是必須要取代現存的I/O技術。但會造成相關的爭論,因為其它的I/O標準也有很多的支持者,而且許多公司已經對這種傳統的技術進行大量的投資。在計算機業界,每一種新技術的出現都傾向於將其它的技術規類於傳統的範疇。至少在理論上,InfiniBand能與PCI、PCI-X、SCSI、光纖通道、IDE/ATA、串列ATA、IEEE-1394以及其它在數據中心存在I/O標準共存。相反,3GIO和HyperTransport是板級的互聯,而快速I/O和緻密PCI主要用於內嵌式系統。

為了與其它的I/O技術協同工作,InfiniBand需要能匹配物理介面和轉換通信協議的橋接適配器。舉例來說,Adaptec正在測試能將InfiniBand連接到串列ATA和串列SCSI的磁碟介面。然而,不要假定你需要的橋接設備已經存在,並且經過實際工作的驗證、價格可行。

另一個要考慮的是性能問題。連接兩種不同的I/O標準通常要增加數據通道的延遲。在最壞的情況下,將InfiniBand網路引入到一個已經安裝多個不同技術組成的網路中,如果組織管理差,會降低其整體性能。InfiniBand的支持者聲稱理想的解決方案是完整的InfiniBand體系結構。任何部件都可以直接連接到InfiniBand網路,可以使用優化的文件協議,最好是使用直接訪問文件系統(DAFS)。

DAFS獨立於傳輸,是基於NFS的共享式文件訪問協議。它是優化過的,用於1到100台機器的集群伺服器環境中的I/O密集、CPU受限、面向文件的任務。典型的應用包括資料庫、web服務、e-mail和地理信息系統(GIS),當然也包括存儲應用。

IT管理員感興趣的其它的與InfiniBand相關協議是:SCSI遠程直接內存訪問(RDMA)協議、共享資源協議(SRP)、IP over InfiniBand (IPoIB)、直接套節字協議(SDP)、遠程網路驅動介面規範(RNDIS)。

SRP的開發在一些公司進展順利,比如,已經開發出早期版本並運行在Windows 2000上協議的Adaptec。OEM的廠商和合作夥伴正在測試beta系統。Adaptec認為SRP對於高性能的SANs會相當出眾,但必須解決多廠商產品間的兼容。最終版本的SRP可能取決於操作系統的驅動程序和伺服器的支持,預計在2002年下半年或2003年上半年完成。

IpoIB,將IP協議映射到InfiniBand,正在被IETF的一個工作組定義。IpoIB包括IPv4/IPv6的地址解析、IPv4/IPv6的數據報的封裝、網路初始化、組播、廣播和管理信息庫。預計在2002年下半年或2003年上半年完成。

SDP試圖解決其它協議的幾個缺陷,特別是相對高的CPU和內存帶寬的利用率。SDP基於微軟的Winsock Direct協議,類似於TCP/IP,但優化後用於InfiniBand,以降低負荷。一個工作組在2000年下半年開始定義SDP,2002年2月完成了1.0規範。

RNDIS是微軟開發的協議,用於基於通道的即插即用匯流排的網路I/O,比如USB和IEEE-1394。InfiniBand RNDIS 1.0規範即將完成。

不要期望一夜成功

儘管所有的廠商都大肆宣傳,市場分析人員也預計有良好前景,但不要期望InfiniBand在一夜之間獲得成功,或者失敗。一方面,InfiniBand要求繼續投資於一個未經完全驗證的技術,特別是當今經濟正從衰退中恢復。儘管可能生產出更多的InfiniBand產品,而不使現存的設備過時,但獲得最大收益要求更廣泛地支持InfiniBand技術,因為InfiniBand技術利用大型交換式網路和本地介面和協議。

一些IT管理員可能會反對這種同時用於存儲、進程間通信和網路傳輸的網路結構,儘管這是InfiniBand的目的。將不同形式的通信運行在不同的匯流排和網路上可以提供一定的冗餘,而InfiniBand也可以通過多個點到點的交換式網路同樣提供冗餘。但他們認為互相分離的網路能夠防止存儲I/O同伺服器和網路通信競爭帶寬。

而另一方面的論點是,InfiniBand統一的網路結構可以簡化IT管理員的工作。一方面,你不必保留不同形式的備份。連接伺服器的同一種電纜也可以同存儲系統協同工作,磁碟子系統可以在不同的子系統之間互換。帶寬的爭奪不大可能成為一個問題,因為InfiniBand可以擴展的網路結構能提供足夠的帶寬,並且很容易增加。而其它的I/O技術,一旦定義了匯流排寬度和時鐘頻率,其理論最大帶寬是固定的,你不能僅僅通過插入纜線來增加更多的帶寬容量,但InfiniBand可以做到這一點。

同樣,統一的、可以重新配置的網路結構能夠很容易地在存儲、網路通信和IPC之間再分配帶寬,而不必關掉關鍵系統來更換硬體。

應該說,InfiniBand的技術基礎是穩固的。當然,除了技術的原因,新的技術有時會因為這樣那樣的原因而出現故障。另外,不成熟的市場和高於期望的費用使許多好的點子成為過眼煙雲。

Infiniband的現狀和未來

2006年11月13日在美國佛羅里達Tampa召開的一年兩次的巨型計算機博覽會(SC06)上公布的世界前500名巨型機的排名中用於伺服器互聯的公開標準協議Infiniband的佔有率首次超過了私有協議Myrinet,而在所有使用了Infiniband的巨型機中Voltaire又以絕對優勢佔了2/3。另外到今年六月為止的世界前500名巨型計算機排名中佔有率一直持續上漲的千兆乙太網也首次下跌18%。至此經過3年多的較量,在高性能計算(HPC)領域伺服器網際網路路的首選協議已經明確為Infiniband。在此想就Infiniband的現狀和發展趨勢向各位讀者做一下介紹。

Infiniband的特點:

Infiniband協議的主要特點是高帶寬(現有產品的帶寬4xDDR 20Gbps,12xDDR 60Gbps,4xSDR 10Gbps,12xSDR 30Gbps、預計兩年後問世的QDR技術將會達到4xQDR 40Gbps,12x QDR 120Gbps)、低時延(交換機延時140ns、應用程序延時3μs、一年後的新的網卡技術將使應用程序延時降低到1μs水平)、系統擴展性好(可輕鬆實現完全無擁塞的數萬端設備的Infiniband網路)。另外Infiniband標準支持RDMA(Remote Direct Memory Access),使得在使用Infiniband構築伺服器、存儲器網路時比萬兆乙太網以及Fibre Channel具有更高的性能、效率和靈活性。

Infiniband與RDMA:

Infiniband發展的初衷是把伺服器中的匯流排給網路化。所以Infiniband除了具有很強的網路性能以外還直接繼承了匯流排的高帶寬和低時延。大家熟知的在匯流排技術中採用的DMA(Direct Memory Access)技術在Infiniband中以RDMA(Remote Direct Memory Access)的形式得到了繼承。這也使Infiniband在與CPU、內存及存儲設備的交流方面天然地優於萬兆乙太網以及Fibre Channel。可以想象在用Infiniband構築的伺服器和存儲器網路中任意一個伺服器上的CPU可以輕鬆地通過RDMA去高速搬動其他伺服器中的內存或存儲器中的數據塊,而這是Fibre Channel和萬兆乙太網所不可能做到的。

Infiniband與其他協議的關係:

作為匯流排的網路化,Infiniband有責任將其他進入伺服器的協議在Infiniband的層面上整合併送入伺服器。基於這個目的,今天Volatire已經開發了IP到Infiniband的路由器以及Fibre Channel到Infiniband的路由器。這樣一來客觀上就使得幾乎所有的網路協議都可以通過Infiniband網路整合到伺服器中去。這包括Fibre Channel,IP/GbE,NAS,iSCSI等等。另外2007年下半年Voltaire將推出萬兆乙太網到Infiniband的路由器。這裡有一個插曲:萬兆乙太網在其開發過程中考慮過多種線纜形式。最後發現只有Infiniband的線纜和光纖可以滿足其要求。最後萬兆乙太網開發陣營直接採用了Infiniband線纜作為其物理連接層。

Infiniband在存儲中的地位:

今天的Infiniband可以簡單地整合Fibre Channel SAN、NAS以及iSCSI進入伺服器。事實上除了作為網路化匯流排把其他存儲協議整合進伺服器之外,Infiniband可以發揮更大的作用。存儲是內存的延伸,具有RDMA功能的Infiniband應該成為存儲的主流協議。比較一下Infiniband和Fibre Channel我們可以看到Infiniband的性能是Fibre Channel的5倍,Infiniband交換機的延遲是Fibre Channel交換機的1/10。另外在構築連接所有伺服器和存儲器的高速網路時使用Infiniband Fabric可以省去Fiber Channel Fabric,從而給客戶帶來巨大的成本節省。

今天在使用Infiniband作為存儲協議方面已經有了很大的進展。作為iSCSI RDMA的存儲協議iSER已被IETF標準化。

不同於Fibre Channel,Infiniband在存儲領域中可以直接支持SAN和NAS。存儲系統已不能滿足於傳統的Fibre Channel SAN所提供的伺服器與裸存儲的網路連接架構。Fibre Channel SAN加千兆乙太網加NFS的架構已經嚴重限制了系統的性能。在這種情況下應運而生的則是由在Infiniband fabric連接起來的伺服器和iSER Infiniband存儲的基礎架構之上的并行文件系統(諸如HP的SFS、IBM的GPFS等等)。在未來的伺服器、存儲器網路的典型結構將會是由Infiniband將伺服器和Infiniband存儲器直接連接起來,所有的IP數據網路將會通過萬兆乙太網到Infiniband的路由器直接進入Infiniband Fabric。

在存儲廠商方面Sun,SGI,LISLO GIC,飛康軟體等公司都已推出自己的Infiniband存儲產品。在中國新禾科技公司也推出了他們的Infiniband存儲系統。

從價格的角度,今天的Infiniband是萬兆乙太網的幾分之一。Inifiniabnd有比FibreChannel高5倍的性能,在價格上則已與Fibre Channel在同一個數量級上。

在HPC以外的領域的Infiniband的應用:

在過去一年裡我們看到Infiniband在HPC以外的領域得到了長足的進步。這主要包括Infiniband在大型網路遊戲中心的應用、Inifiniband在電視媒體編輯及動畫製作方面的應用。在證券業方面,人們也已經在著手開發以Infiniband為核心的高速、低遲延交易系統。在銀行業我們也看到了一些以Inifiniband全面取代Fibre Channel的努力。

明、後年Infiniband的看點:

Voltaire將於2003年秋天推出萬兆乙太網到Infiniband的路由器。這將使由Infiniband對數據網路存儲網路的整合得到加速。

Voltaire已經開發出全套的iSER Initiator、Target code。很多存儲合作夥伴在利用Voltaire的iSER code開發他們獨自Infiniband存儲系統。預計在明、後年大家會看到更多的Infiniband存儲系統投放市場。

Infiniband已經進入刀片伺服器(IBM、HP等等),我們在未來的兩年還會看到這方面更多的努力和成功。

Infiniband標準裝配在伺服器上的努力和成功。

裝載Infiniband存儲的巨型機進入世界前500巨型機列表。

Infiniband在網路遊戲業、石油業、電視媒體業、製造業等方面進入企業級應用。

Infiniband:曲高和寡前途未卜

步入2008,數據中心的應用環境發生了巨大的變化,多核、虛擬化和刀片成為新一代數據中心的主流趨勢,在這樣的主流趨勢下,有些人預測InfiniBand也將迎來其生命周期的黃金時代,有些人則持反對意見

銜著金鑰匙出生

早在2001年,一位國外專家Sandra Gittlen第一次為Network Word的年度熱門問題撰寫了關於當時出現的被稱作的互聯架構的文章。

以下是Sandra Gittlen文章的開篇:

“它就是治療網路瓶頸問題的靈丹妙藥,InfiniBand,下一代的個人電腦輸入/輸出架構,將隨時準備取代PCI的地位,成為伺服器的新標準。”

那時候,大多數人都對InfiniBand給予厚望,有充分的理由相信InfiniBand即將闖入市場,將會大展拳腳,並可一舉取代數據中心的網路。當時,有排成行的公司為此下了重資。事實上,有超過2億美元的風險投資在那個時候注入了與InfiniBand相關的公司。其中的翹楚有Dell,HP,Compaq,Intel,IBM,Microsoft和Sun,這些大公司都為這項技術的發展而努力著。

InfiniBand,用最簡單的話說,就是在伺服器端一個主機通道適配器和存儲設備等外設上的目標適配器之間的高速架構,因為這些適配器之間直接通訊,下載、安全和服務質量等可以內置。

時間一閃到了2005年,情況發生了巨變。

那時候,很多早期獲得了關注的創業公司或是破產,或是被兼并,或是被收購。只有一些倖存了下來。在這段期間,同樣是Sandra Gittlen給Network World寫了另外一篇文章,是關於高性能計算和數據中心用戶在高速度互聯方面有成千上萬的選擇。

一家存活至今的InfiniBand公司,Mellanox Technologies的市場部副總裁Thad Omura承認:雖然InfinBand技術發展至今已經相對成熟了,但卻受到了經濟衰退的影響。“在那段蕭條的時期里,人們不會傾向於在新的互聯技術上進行投資。”

一晃又是兩年,情況又發生了一些改變。今天,我們在互聯方面的投資不斷增加,而如何利用互聯技術降低數據中心或高性能計算的成本方面也開始回暖。時至今日,恐怕大家又要重新審視這個問題了:InfiniBand的時代終於來臨了嗎?

上個月,IDC發布了一份有關InfiniBand的調研報告,在這份關於InfiniBand在全世界範圍內的發展預測中,IDC認為:“正是由於網路中不斷增長的需要,才推動了超越從前的重要商業服務的出現,以前那種伺服器和存儲資源之間的互聯已經不能滿足現在的帶寬和容量了。因此,有些客戶在尋找現有互聯結構的替代品,能夠完全滿足吞吐量上的要求,也就是需要更多的帶寬和更短的延遲。”

IDC還認為:“高性能計算,向外擴展的資料庫環境,共享和虛擬化的輸入/輸出,以及有類似高性能計算特徵的財務軟體應用已經推動了很多InfiniBand的發展,並將帶來更多InfiniBand的推廣和應用。”

在報告中,IDC預測2011年InfiniBand產品製造收入將從2010年的15,720萬美元升至61,220萬美元。

多核、虛擬化和刀片是推動力

這些消息對於Omura這樣的infiniband廠商來說是個好消息。Omura的客戶包括HP、IBM以及Network Appliance,這些一流的大廠都將InfiniBand技術使用到了自己的產品中,讓人對infiniband更增添了一些信心。

Omura發言人表示,各種趨勢都在推動這種應用。“我們已經進入了多核CPU的時代,因此需要更多帶寬和更短的延遲;虛擬化則推動了統一輸入/輸出架構進程;刀片伺服器埠有限,但卻連接到同一塊背板上,這些趨勢都在加速著InfiniBand的發展。”

根據infiniband技術的發展,InfiniBand的吞吐量是20Gb每秒,到2008年能達到40Gb每秒。與之相比的10G乙太網,2008年之前吞吐量上則不會有什麼改變。

此外,對於數據中心目前而言最重要的問題是解決延遲時間的問題,InfiniBand延遲時間是1微妙,乙太網的延遲則接近於10微秒。

難怪Omura發言人如此樂觀:“如果InfiniBand可以幫助我們既降低成本,又節約能源,還有更快的處理速度,人們肯定會選擇它的。”

他以一個貿易公司為例,“如果你在交易過程中快了1毫秒,你一年的收益就可以達到1億美元。最先吃螃蟹的是高性能計算領域的公司,其次是金融機構。如今我們看到那些資料庫驅動的實時應用,比如票務預訂系統,正在普遍使用InfiniBand產品。”

應該說整個IT行業最近幾年在InfiniBand上的收益可能並不夠豐厚,但是產品的研究與開發並沒有停滯不前。另外一家InfiniBand公司Mellanox也賺了個盆滿缽滿。他說:“從2001年到2005年,我們的收入年年都翻番。”而且他認為大規模生產的出現還要再過上幾個月的時間。

發展的阻礙

就在一些infiniband廠商對InfiniBand的前途異常樂觀之時,在2005年曾經收購了InifiniBand廠商Topspin Communications的Cisco卻認為IDC關於InfiniBand技術在企業級應用前景的預測是“過於樂觀了”。

Cisco的伺服器虛擬化事業部銷售主管Bill Erdman認為:“目前InfiniBand的應用還不足以說明InfiniBand時代的到來。”

Erdman說延遲時間短是InfiniBand產品的最大價值,但是IDC提到的其他驅動力,比如虛擬化,則在InfiniBand應用上有點困難。

“虛擬化需要特殊的設備和做好定義的管理範式,輸入/輸出整合則需要在InfiniBand和乙太網/光纖通道之間的通路,並且簡單假設隨著客戶增加應用軟體和網站主機層卻不需要額外的防火牆、內容負載均衡以及網路入侵防禦系統等服務。”他說,“InfiniBand並沒有和這些服務整合在一起。”

Cisco已經看到InfiniBand產品在資料庫、後端資料庫主機以及信息匯流排程序上的應用。“不過,如果有其他應用程序,需要更豐富的主機服務,乙太網仍然是伺服器主機技術的選擇。”Erdman表示。

Cisco與IDC意見相左,因此很難說InfiniBand產品是否能最終大舉進攻企業級市場。但是infiniband技術已經蹣跚了這麼久,走了這麼遠,筆者有信心infiniband還能繼續走下去。那就讓我們拭目以待吧。

應用案例1:大數據持續爆發

像Oracle Exadata這樣的大數據方案提供商已經將InfiniBand部署在他們的設備內部好幾年了,對於需要高速計算能力和大量內部數據流的橫向擴展應用程序來說,InfiniBand是一個理想的交換結構解決方案。

正在部署開源Hadoop的用戶應該了解他們的大數據集群是如何在InfiniBand網路中變得更強大的,與傳統的10GB乙太網相比,hadoop集群中的InfiniBand網路將分析吞吐量翻了一倍,因為需要更少的計算節點,由此累計省下來的開支比部署InfiniBand網路通常要多很多。

只要數據在容量和種類上持續增長,高性能的數據交換就會一直是數據中心網路的一個巨大挑戰,如此一來高帶寬和低延遲的InfiniBand網路使得它成為一個具有競爭力的替代方案。

應用案例2:虛擬數據中心的虛擬I/O

為了滿足虛擬環境下關鍵應用程序的可用性和性能,IT必須虛擬整個I/O的數據路徑,包括共享存儲和連接網路,反過來,I/O數據路徑,必須能夠支持多協議和動態配置。

為了加強運行關鍵程序的虛擬機的移動性,虛擬機必須能夠無縫而且快速的將整個網路和存儲遷移到另外一個地方。這意味著支撐其運作的物理架構必須被每台主機同等的連接到。但是由於主機一般都有不同的物理網卡和物理網路連接,虛擬機的無縫移動成了一個挑戰。像InfiniBand這樣聚合、平坦的網路架構提供了一個巨大的管道,可以動態按需分配,這使得其在緊密、高移動性的虛擬環境下變得尤為理想。

應用案例3:橫向擴展的網頁需要緊密互連

基於網頁的應用程序需要的基礎設施不僅僅支持虛擬化的雲計算資源,還需要額外的移動性和靈敏性去支持動態重新配置,而不用去關心現有的數據流或者現有的連接要求。因此,InfiniBand的扁平地址空間對於服務提供商和基於網頁的大型商業程序來說,是一個巨大而且實用的福利。

對那些數據流體現為數量眾多而且數據量很小的(比如隨機存儲讀寫、遠程內存直接讀寫、消息隊列)應用程序來說,在同等條件下將網路延遲減少一半可以極大的改善應用程序基本的性能和吞吐量,極大的減少對基礎設施的要求和極大的縮減開支。

應用案例4:高度密集的設備共享和匯聚

隨著數據中心裡的設備越來越密集,用戶正在利用前端網路來匹配後端帶寬的方式來將資產的利用率最大化。換句話說,如果InfiniBand能夠成為高性能、橫向擴展存儲系統的選擇,它也應該成為存儲前段連接的一種選擇。

最近流行的擴展伺服器端存儲的趨勢需要一個InfiniBand這樣一個更優於高級緩存的架構,它要麼在伺服器之間直接共享數據,或者緊密整合外在共享存儲設備。兼顧到存儲和伺服器的實際效果就是它同時可以處理前端存儲I/O和後端存儲I/O,因而InfiniBand網路可以扮演一個非常傑出的角色。